Proces K.G.M. przeciw gigantom social mediów: czy algorytmy „uzależniają” młodych i kto za to odpowie?

Proces w Los Angeles może stać się przełomem dla platform społecznościowych. K.G.M. zarzuca Meta i YouTube, że algorytmy i funkcje typu infinite scroll oraz autoplay sprzyjały uzależnieniu i pogorszeniu zdrowia psychicznego.

W Los Angeles ruszył właśnie „proces stulecia”, który media w USA porównują do wielkiej batalii z koncernami tytoniowymi. 20-letnia dziś Kaley (występująca jako K.G.M.) rzuca wyzwanie Markowi Zuckerbergowi i gigantom z Doliny Krzemowej. Zarzut? Celowe uzależnianie dzieci i wpędzanie ich w depresję dla zysku.

Na sali rozpraw w Los Angeles County Superior Court zapadła cisza, gdy prawnicy młodej powódki zaczęli opisywać mechanizmy, które towarzyszyły jej niemal przez całe dzieciństwo. Kaley G.M. zaczęła przygodę z YouTube’em jako 6-latka, a na Instagramie pojawiła się w wieku 9 lat. Dziś twierdzi, że platformy te nie były niewinnymi aplikacjami, ale precyzyjnie zaprojektowanymi „pułapkami”. Pozew pierwotnie obejmował też TikToka i Snapchata, ale te firmy zawarły ugody tuż przed startem sprawy.

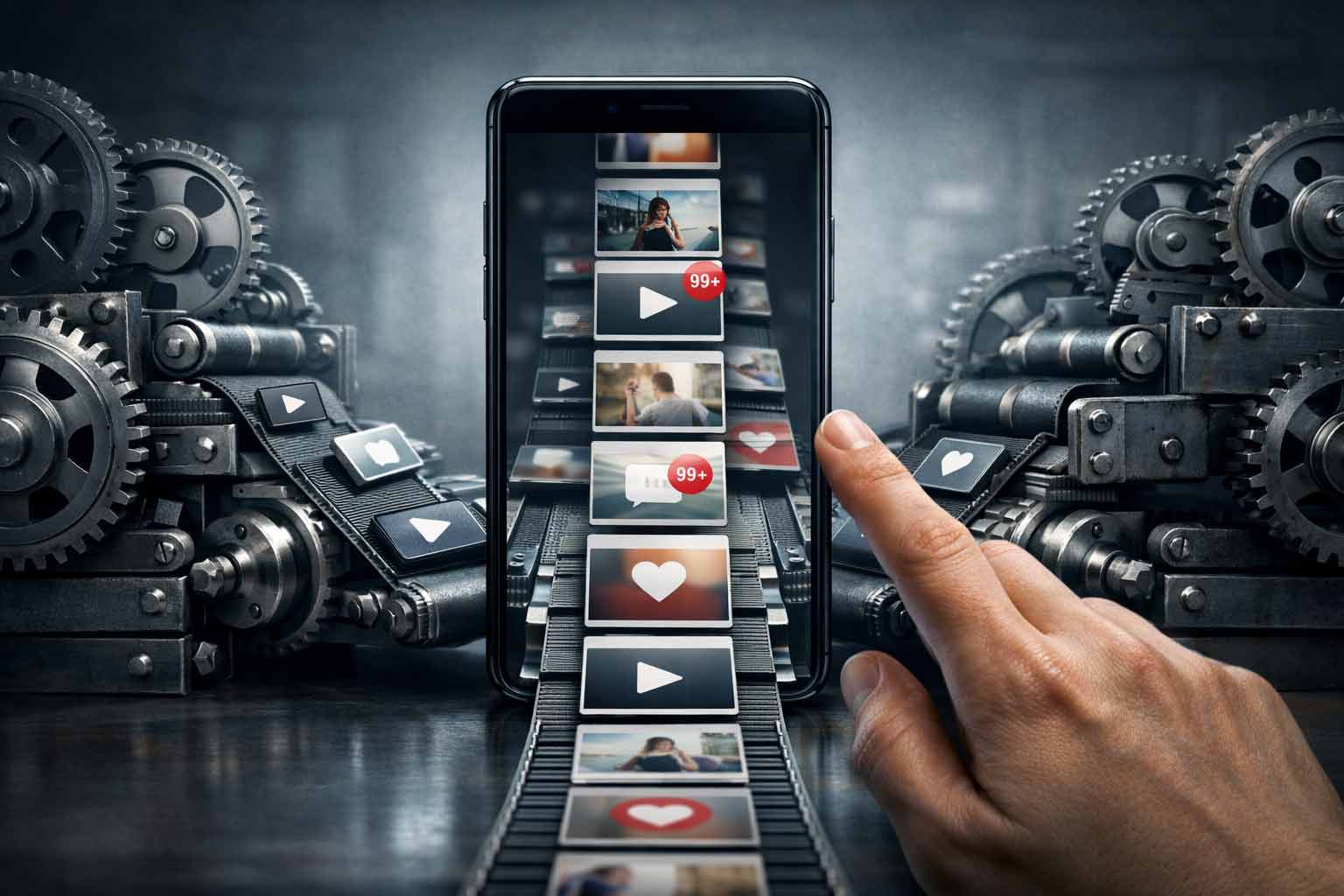

To nie jest kolejna dyskusja o „za dużej ilości czasu w telefonie”. Stawką są konkretne rozwiązania: nieskończone przewijanie, autoplay, powiadomienia i systemy rekomendacji, które – zdaniem powodów – nie tylko podbijają zaangażowanie, ale też mogą szkodzić szczególnie wrażliwym, młodym osobom.

Kim jest K.G.M. i o co chodzi w tej sprawie?

K.G.M. to młoda kobieta z Kalifornii, która (razem z matką) zarzuca firmom technologicznym, że ich platformy zostały zaprojektowane w sposób „uzależniający z definicji” – tak, by jak najdłużej utrzymywać uwagę użytkownika. W pozwie padają wątki dotyczące wpływu korzystania z aplikacji na jej samopoczucie i zdrowie psychiczne, a także teza, że firmy miały wiedzieć o ryzykach, ale nie ostrzegać wystarczająco i nie chronić nieletnich.

Kogo pozwała – i dlaczego część firm „zniknęła” z sali sądowej?

Sprawa zaczynała się szeroko: w pozwie wskazywano m.in. Meta (Instagram/Facebook), Google/YouTube, TikToka oraz Snapchata. Jednak Snap zawarł ugodę 20 stycznia 2026, a TikTok ogłosił porozumienie w zasadzie (również bez ujawniania szczegółów) tuż przed rozpoczęciem procesu. Na placu boju zostali więc głównie Meta i Google/YouTube, które bronią się, podważając związek przyczynowo-skutkowy i wskazując na inne czynniki w życiu powódki.

Co dokładnie jest „na celowniku” – algorytmy, a nie treści

Ważny szczegół: sednem sporu nie jest to, że w internecie istnieją trudne treści. Kluczowe pytanie brzmi, czy sam projekt produktu – mechanika aplikacji i sposób podawania kolejnych materiałów – może być uznany za wadliwy i szkodliwy. W praktyce chodzi o funkcje, które utrudniają „odłożenie telefonu”: autoplay, infinite scroll, system powiadomień, pętle nagród i rekomendacje dopasowane pod emocje oraz reakcje użytkownika.

Powodowie przekonują, że wewnętrzne materiały firm (przywoływane w sprawie) mają pokazywać, iż platformy rozumiały, jak silnie takie rozwiązania wpływają na młodych. Obrońcy odpowiadają: użytkownik ma ustawienia, narzędzia kontroli i wybór, a dane o użyciu w tej konkretnej historii nie potwierdzają narracji o „ciągłym wciąganiu”.

„Addicting Brains of Children” – ABC oskarżenia

Mark Lanier, reprezentujący Kaley i jej matkę (współpowódkę), streścił strategię ataku w trzech literach: ABC – Addicting, Brains, Children (Uzależnianie Mózgów Dzieci). Przedstawił wewnętrzne dokumenty, z których wynika, że Meta (Instagram) i Google (YouTube) wiedziały o szkodliwości swoich produktów, ale ignorowały ostrzeżenia własnych pracowników.

„Oni nie chcieli użytkowników, oni chcieli nałogowców” – grzmiał Lanier w mowie wstępnej.

Dlaczego ten proces jest tak głośny?

Bo to „testowa” (bellwether) sprawa obserwowana przez prawników i regulatorów: jej wynik może wpłynąć na strategię w kolejnych postępowaniach dotyczących szkód u młodzieży. Jeżeli ława przysięgłych uzna, że odpowiedzialność dotyczy projektu platform (a nie tego, co użytkownicy publikują), może to wzmocnić falę kolejnych roszczeń i nacisk na zmiany w aplikacjach dla nieletnich.

Kiedy wystartował proces i co dalej?

Proces w Los Angeles nabrał tempa na początku lutego 2026 (po wcześniejszych ruchach proceduralnych i ugodach części pozwanych). Według doniesień medialnych sprawa ma potrwać kilka tygodni, a wśród spodziewanych świadków mają pojawić się także czołowi menedżerowie powiązani z platformami.

W praktyce najważniejsze będą trzy elementy: (1) czy sąd i ława przysięgłych uznają, że funkcje platform da się oceniać jak „produkt” ze skutkami ubocznymi, (2) czy uda się wykazać realny związek między projektem aplikacji a konkretną szkodą, (3) czy firmy będą musiały zmienić to, jak działają mechanizmy rekomendacji i angażowania młodych użytkowników.

Co ten proces może zmienić dla zwykłych użytkowników?

Nawet jeśli nie śledzisz sprawy na bieżąco, jej skutki mogą być odczuwalne: od mocniejszych domyślnych ograniczeń dla kont nastolatków, przez mniej agresywne rekomendacje, po większą przejrzystość tego, dlaczego widzisz dane treści. A jeśli dojdzie do kolejnych ugód – może to przyspieszyć „cichą” przebudowę funkcji, które dziś są standardem w większości aplikacji.

Najważniejsze fakty w skrócie

- Powódka: K.G.M., ok. 20 lat (występuje pod inicjałami).

- Główni pozwani w procesie: Meta (Instagram/Facebook) oraz Google/YouTube.

- Ugody przed procesem: Snapchat (20 stycznia 2026) i TikTok (porozumienie w zasadzie pod koniec stycznia 2026).

- Temat sporu: projekt aplikacji i algorytmy angażujące młodych użytkowników (autoplay, infinite scroll, powiadomienia, rekomendacje).

- Dlaczego to ważne: sprawa „testowa”, która może wpłynąć na kolejne pozwy i praktyki projektowania platform.

Komentarz redakcyjny KobietaMag.pl

W redakcji KobietaMag.pl od dawna obserwujemy, jak mocno zmienił się sposób „konsumowania” internetu – szczególnie przez nastolatki. I choć każda historia jest inna, jedno jest wspólne: to nie tylko treści wpływają na młodych ludzi, ale przede wszystkim mechanizm ich podawania. Nieskończone przewijanie, autoplay, agresywne powiadomienia i rekomendacje „na emocjach” potrafią wciągać jak serial bez końca – tylko że tu stawką bywa samopoczucie, poczucie własnej wartości, sen i zdrowie psychiczne.

Właśnie dlatego ten proces uważamy za ważny – nie jako „atak na technologię”, lecz jako próbę postawienia granicy: czy wolno projektować produkt dla nieletnich tak, żeby maksymalizował czas spędzony w aplikacji kosztem dobrostanu? Dla dorosłych to często „zabijanie czasu”. Dla młodych – w okresie, kiedy emocje są intensywne, a samoocena dopiero się buduje – może to być środowisko, które wzmacnia lęk, porównywanie się, FOMO i poczucie, że zawsze jest się „nie dość”.

Nie twierdzimy, że media społecznościowe są z definicji złe. Wiele młodych osób znajduje tam wiedzę, inspiracje, relacje i wsparcie. Ale jednocześnie widzimy, że algorytmy nie są neutralne: promują to, co zatrzymuje uwagę, a nie to, co służy zdrowiu. A jeśli coś jest projektowane po to, by użytkownik nie mógł „wyjść” – to przestaje być niewinną rozrywką, a zaczyna być mechanizmem, który wymaga odpowiedzialności.

Naszym zdaniem potrzebne są realne zmiany: mniej agresywnych rekomendacji dla nieletnich, mocniejsze ustawienia prywatności i bezpieczeństwa „z automatu”, większa przejrzystość (dlaczego widzę dane treści), a także prostsze narzędzia dla rodziców i opiekunów – bez udawania, że „wszystko jest pod kontrolą”, gdy dziecko ma telefon w dłoni 24/7.

Dlatego będziemy przyglądać się tej sprawie dalej. Bo nawet jeśli finalny wyrok nie rozwiąże całego problemu, to może uruchomić coś, czego dziś brakuje najbardziej: poważną rozmowę o odpowiedzialności projektowania aplikacji dla młodych ludzi – zanim kolejne pokolenie zapłaci za „engagement” własnym zdrowiem psychicznym.